L’espressione “intelligenza artificiale” (Artificial Intelligence, A.I.) venne coniata nel 1956 da John McCarthy, un giovane professore di matematica statunitense interessato a implementare la ricerca in ambito informatico, per indicare una disciplina, tutt’oggi in continua evoluzione, che si occupa principalmente di studiare la possibilità di realizzare una macchina in grado di replicare l’intelligenza umana. In particolare, con intelligenza artificiale si fa riferimento al programma (software) in grado di guidare la macchina (hardware). Tali studi sono oggetto di interesse per discipline anche molto diverse tra loro, dalla matematica e informatica fino all’etica e alla filosofia.

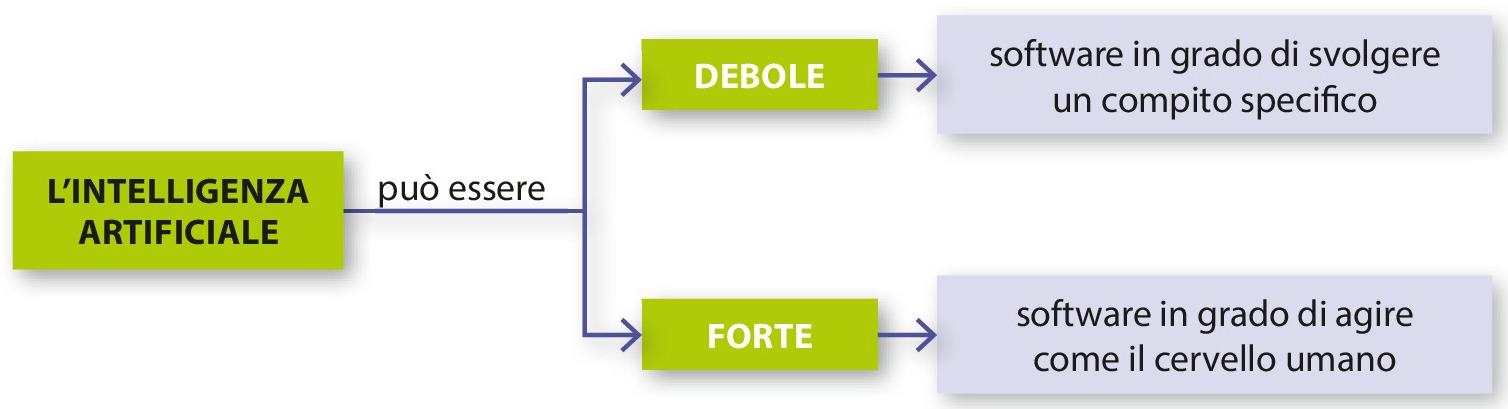

Al giorno d’oggi è possibile distinguere due tipi principali di intelligenza artificiale.

- Intelligenza artificiale debole, ovvero lo sviluppo di un software intelligente specializzato nell’esecuzione di un compito specifico, come per esempio il computer Deep Blue, prodotto dall’IBM, che fu in grado di battere il campione del mondo di scacchi, Garry Kasparov, nel 1996.

Appartengono a questa categoria molte risorse che usiamo quotidianamente, come per esempio Siri, la “voce” degli Iphone, capace di interfacciarsi alle richieste che le vengono fatte dall’essere umano. Funzionando come un motore di ricerca, Siri è programmata per rispondere alle domande che le vengono poste attraverso la selezione dei risultati che attinge dalla rete e quindi gestendo le informazioni. Questo tipo di intelligenza artificiale è però incapace di operare al di fuori dello specifico e ristretto ambito di applicazione per cui è stata progettata. - Intelligenza artificiale forte, o Human-Level Artificial Intelligence, ovvero un computer intelligente come un essere umano, in grado di effettuare diversi compiti intellettuali in ambiti differenti. Non è ancora stato possibile creare una macchina di questo tipo in quanto, per funzionare correttamente, sarebbe necessario ideare un programma capace di utilizzare il ragionamento, la pianificazione, il pensiero astratto, la comprensione di idee complesse e la capacità di imparare velocemente dall’esperienza. In altre parole, un programma capace di simulare le reti neurali che sono alla base dei processi mentali. Questo livello di intelligenza artificiale, una volta sviluppato, potrebbe diventare molto più intelligente dei migliori cervelli umani in tutti i campi dello scibile, inclusa la creatività scientifica, la saggezza generale e le competenze relazionali.

Per quanto riguarda i passi in avanti che la ricerca ha compiuto finora, l’informatico statunitense Donald Knuth ha sottolineato che ad oggi l’intelligenza artificiale riesce a fare gran parte di ciò che richiede l’atto di pensare, ma non riesce a compiere la maggior parte delle azioni che le persone eseguono senza pensare.

Questo significa, per esempio, che per un computer è molto più semplice giocare a scacchi o moltiplicare grossi numeri in una frazione di secondo piuttosto che distinguere un cane da un gatto. Infatti, fin dall’origine della specie gli esseri umani hanno dovuto imparare a riconoscere ciò che gli si palesava davanti. Basti pensare agli uomini primitivi per i quali era una questione di sopravvivenza capire se si trovavano in presenza di un cerbiatto o di una tigre. Migliaia di anni e di evoluzione ci hanno insegnato a cogliere, senza doverci soffermare a pensare, ciò che ci troviamo di fronte; diversamente vale per i calcoli matematici complessi, che i nostri cervelli biologici compiono da poche centinaia di anni perché prima semplicemente non servivano, né esistevano. Una stringa di codice ben realizzato in quel caso è in grado di batterci in un battibaleno.

ESEMPIO: per capire ancora meglio come sia difficile riprodurre il funzionamento del cervello umano si pensi al captcha, che spesso viene richiesto prima di accedere a una pagina web: una sequenza di lettere scritta in modo storto e discontinuo che va riconosciuta e riscritta in uno spazio apposito per poter proseguire nella navigazione in rete. L’essere umano è in grado di distinguere le lettere dal momento che il cervello è abituato a processare informazioni dotate di prospettiva, angolature e distorsioni percettive | ▶ UNITÀ 2 , p. 56 |, i programmi software, invece, non sono generalmente in grado di riconoscerle.